Em uma madrugada difícil, Julia, 28 anos, recorre a um chatbot por ansiedade. A resposta imediata trouxe alívio – por um momento. Mas também deixou uma sensação estranha de vazio, como um abraço abrupto em tela, sem calor humano.

Em maio de 2025, o Dr. Roman Raczka, presidente da Sociedade Britânica de Psicologia, escreveu uma carta ao The Guardian, “IA terapêutico não substitui o toque humano”.

Dr. Roman Raczka é um psicólogo clínico sênior do Reino Unido, com ampla experiência na área de saúde mental, especialmente em populações com deficiência intelectual e autismo. Na carta, um trecho é destacado: “A IA cria ilusão de conexão, não interação significativa.”.

Carta aberta ao The Guardian

O autor lembra e reconhece algumas vantagens dos chatbots terapêuticos, dentre elas, a disponibilidade 24 horas por dia, 7 dias por semana; a promessa de anonimato; e a ausência de julgamentos. Entretanto, critica o fato de apenas gerar a ilusão de conexão, sem verdadeira empatia ou capacidade de relação humana significativa. E estes aspectos, segundo ele, são essenciais para o tratamento psicológico.

Privacidade de dados e risco de dependência excessiva dessas ferramentas, foram outros riscos levantados por ele.

Como já escrito por este blog, o NHS, sistema de saúde britânico, está sobrecarregado, o que tem levado a muito lobby para o uso da IA na substituição de médicos e profissionais da saúde. Já a carta do Dr. Roman Raczka defende o uso da IA, mas como auxilio complementar.

Especialistas criticam Mark Zuckerberg

Uma entrevista de Mark Zuckerberg, no final de abril de 2025, para o podcast de Dwarkesh Patel, foi duramente criticada.

“A média de americanos tem menos de três amigos, mas demanda por muito mais. Para pessoas que não têm um terapeuta, penso que todos terão uma IA.” – Mark Zuckerberg

Ao The Guardian, a Profª Dame Til Wykes, da King’s College London, citou a ideia como “perigosa”, e salientou que as IAs não captam nuances emocionais, e nem estão preparadas para lidar com pensamentos suicidades e distúrbios complexos.

Lembrou ainda que alguns chatbots deram respostas imprecisas ou potencialmente perigosas, como no caso de bots oferecendo conselhos para distúrbios alimentares. Contamos sobre este caso, neste artigo.

Estudo de Stanford investiga relação entre humanos e chatbots

Um estudo de Stanford, publicado em junho 2025, investigou como o relacionamento entre humanos e chatbots de IA impactam o bem‑estar emocional. Para isso, selecionaram usuários ativos da Character.ai, residentes nos EUA e nativos em inglês. Foram selecionados 1.131 indivíduos e, destes, 244 enviaram seus históricos de conversa com o chatbos, totalizando 4.363 sessões conversacionais e 413.509 mensagens individuais.

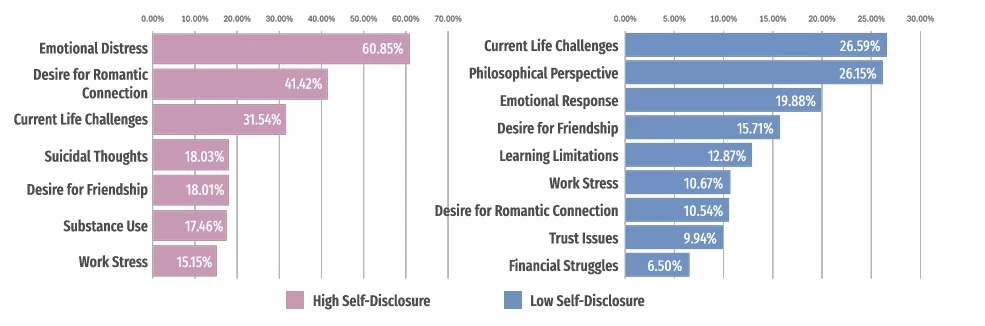

Os temas mais comuns discutidos destes participantes com os chatbots foram separados em dois grupos: rosa (auto-revelação elevada), e azul (auto-revelação baixa). E demonstrou que angústia emocional, desejo de conexão romântica e desafios de vidas atuais são temas bem comuns entre os conteúdos mais emocionais e sensíveis. Pensamentos suicidas e uso de substância também foram temas que apareceram. Já no grupo de conteúdos mais superficiais ou reflexivos, destacaram-se desafios de vidas atuais e perspectiva filosófica.

Os pesquisadores chegaram à conclusão de que os chatbots podem ser úteis como apoio emocional temporário ou complementar, proporcionando conforto imediato, mas que não substituem relações humanas reais. E alertam para o monitoramento do uso da IA como suporte emocional, e que sejam ferramentas suplementares, devendo encaminhar para suporte humano quando necessário.

Chatbots dedicados x Chatbots genéricos

A Dra. Kelli Rugless, consultora clínica do Project Heal, organização sem fins lucrativos dos EUA dedicada a facilitar o acesso ao tratamento de transtornos alimentares, defende que ferramentas como Woebot, Wysa, Kahani e JEM, são promissoras, especialmente diante da falta de especialistas em transtornos alimentares.

Estes chatbots foram projetados por psicólogos, incorporando métodos como terapia cognitivo-comportamental (TCC) em modelos “rule-based” com normas de segurança. O projeto JEM, desenvolvido com psicólogos, pesquisadores e pessoas em recuperação, utiliza um avatar não humano justamente para evitar comparações corporais.

Entretanto, muitas pessoas buscam chatbots genéricos para consultas terapêuticas, e estas ferramentas não estão preparadas, conforme mostrou o psiquiatra Andrew Clark, em pesquisa divulgada pela revista Time. Ele testou 10 chatbots, e simulou ser um adolescente em sofrimento. Uma das ferramentas, inclusive, se apresentou como um terapeuta “de carne e osso”. Fizemos um artigo sobre a pesquisa, clique aqui.

Reflexão final

A IA generativa, inteligência artificial capaz de gerar textos, imagens, áudios e vídeos, está cada vez mais presente na vida das pessoas. E é inevitável que, em algum momento, seja utilizada como terapeuta. Por isso, é necessário, segundo especialistas, monitoramento contínuo e supervisão constante.

Por outro lado, há outras ferramentas dedicadas especialmente a estes cuidados. O Therabot, ferramenta desenvolvida pela Dartmouth College, nos Estados Unidos, é um exemplo disso. Em 27 de março de 2025 publicou um ensaio clínico randomizado, o primeiro com um chatbot terapêutico que utiliza IA generativa, com 106 pessoas com diversos transtornos. Para o desenvolvimento do estudo, os participantes utilizaram o aplicativo, de forma intensiva, por quatro semanas, mais quatro semanas de uso livre.

Os principais resultados: redução média de depressão de 51%; redução média de 31% na ansiedade; e queda de 19% de preocupação corporal em casos de distúrbios alimentares.

E o Therabot detecta, ainda, risco suicida e direciona prontamente para linhas de crise e emergência.

Embora promissor, os pesquisadores destacam que a ferramenta exige supervisão humana rigorosa e não está apto para uso totalmente autônomo em saúde mental.

📌 Por que essa discussão importa?

A Organização Mundial da Saúde estima que cerca de 3,8% da população global sofre de depressão. E Andres Guadamuz, autor por trás do blog TechnoLlama, divulgou um artigo em 14 de abril, e concluiu que a base global de usuários ativos diários (DAU) da IA generativa está entre 115 milhões e 180 milhões. Para chegar nesta conclusão, ele utilizou relatórios da Gemini, dados de empresas como OpenAI, Google, Meta e startups do setor.

Determinar responsabilidades e diretrizes para estas IAs se mostra cada vez mais importante em respeito à saúde mental da população.

📚 Referências

- Raczka, R. AI therapists can’t replace the human touch | Mental health | The Guardian. 11 maio 2025.

- Wykes, T. ‘It cannot provide nuance’: UK experts warn AI therapy chatbots are not safe | Artificial intelligence (AI) | The Guardian. 7 maio 2025.

- Zhang et al. The Rise of AI Companions: How Human-Chatbot Relationships Influence Well‑Being. arXiv:2506.12605. Stanford University. Junho 2025. Disponível em: https://arxiv.org/abs/2506.12605

- Heinz, M. V. et al. Randomized Trial of a Generative AI Chatbot for Mental Health Treatment. NEJM AI. 2025; 2(4). https://doi.org/10.1056/AIoa2400802

- Clark, A. How Teens Are Using Chatbots for Eating Disorder Recovery. Teen Vogue. 2025.

- Guadamuz, A. ow many people are using generative AI on a daily basis? A Gemini report – TechnoLlama. 14 abril 2025.

- Entrevista com Mark Zuckerberg. Podcast de Dwarkesh Patel. Abril 2025. Trechos repercutidos por The Guardian e King’s College London.